Processamento de imagens médicas é a disciplina que combina física de formação de imagem, matemática aplicada e inteligência artificial para extrair informação clínica útil a partir de dados gerados por modalidades como tomografia computadorizada, ressonância magnética, ultrassom e medicina nuclear. O campo vive sua transformação mais acelerada: o FDA autorizou 1.356 dispositivos baseados em IA até setembro de 2025, com 295 apenas naquele ano, e modelos de fundação como MedSAM2, BiomedParse e Med-Gemini redefinem o que é possível em segmentação e diagnóstico automatizado. No Brasil, com um mercado de dispositivos avaliado em US$ 15,28 bilhões em 2024 e filas de exames que chegam a 2034 em algumas cidades, dominar esse conhecimento é ao mesmo tempo oportunidade profissional e contribuição concreta ao sistema de saúde.

Este artigo faz parte do Guia Definitivo de Engenharia Biomédica.

Modalidades de imagem médica: princípios físicos

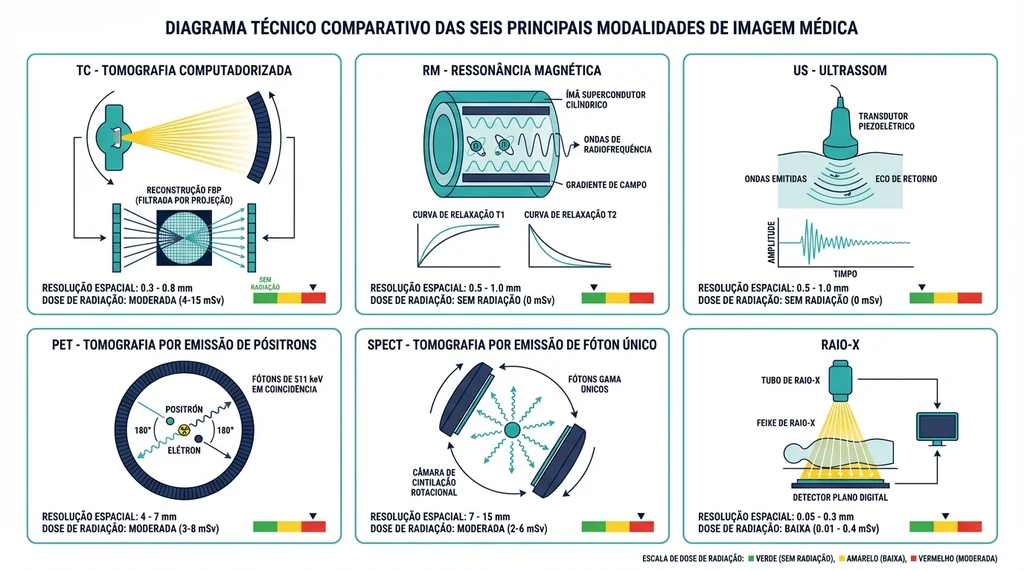

Cada modalidade de imagem utiliza um fenômeno físico distinto para interrogar o corpo humano. Entender esses princípios não é curiosidade acadêmica, eles determinam que tipo de artefato esperar, que técnica de pré-processamento aplicar e quais limitações o algoritmo de IA precisará contornar.

Raio-X e tomografia computadorizada

Raio-X e TC exploram a atenuação de fótons descrita pela lei de Beer-Lambert: I = I₀ · e^(−µx), onde µ é o coeficiente de atenuação linear do tecido. A TC adquire múltiplas projeções angulares e reconstrói o volume por retroprojeção filtrada (filtro Ram-Lak) ou métodos iterativos (MLEM, OSEM, MBIR). Os valores resultantes são expressos em Unidades Hounsfield: água = 0 HU, ar = −1.000 HU, osso cortical ≈ +1.000 HU, gordura ≈ −100 HU. A nova geração de detectores photon-counting CT (CdZnTe) conta fótons individuais, reduzindo dose e aumentando contraste espectral.

Descrição completa da imagem

Diagrama comparativo dos princípios físicos das seis modalidades de imagem médica: raio-X, TC, RM, ultrassom, PET e SPECT com resolução e dose (120 chars).

Ressonância magnética

A RM baseia-se na ressonância nuclear magnética de prótons de hidrogênio. Campos de 1,5 T, 3 T ou 7 T alinham os spins; pulsos de radiofrequência na frequência de Larmor os perturbam; a relaxação T1 (longitudinal) e T2 (transversal) gera o contraste. Os dados são adquiridos no espaço k (domínio de Fourier) e reconstruídos pela transformada inversa. Sequências como spin echo, gradient echo e EPI oferecem diferentes compromissos entre contraste, tempo de aquisição e artefatos de movimento. A ausência de radiação ionizante é vantagem central. Um exemplo de avanço recente na área é o novo sistema SIGNA da GE Healthcare aprovado pelo FDA em 2026.

Ultrassom e medicina nuclear

O ultrassom usa transdutores piezoelétricos com frequências de 2–18 MHz. A resolução axial (0,1–1,0 mm) cresce com a frequência, enquanto a penetração diminui, compromisso fundamental no projeto de sondas. Modos B, M e Doppler fornecem morfologia, movimento e fluxo. A medicina nuclear (PET e SPECT) mensura atividade metabólica: no PET, FDG-¹⁸F emite pósitrons que geram fótons de 511 keV em coincidência, com resolução de 4–6 mm; no SPECT, gama-câmaras detectam Tc-99m, com resolução de 8–12 mm.

| Modalidade | Princípio físico | Resolução espacial | Dose | Ponto forte clínico |

|---|---|---|---|---|

| Raio-X simples | Atenuação de fótons X | 0,1–0,2 mm (plano) | 0,01–10 mSv | Ossos, tórax, acesso rápido |

| TC | Atenuação multidirecional + reconstrução | 0,5–1,0 mm (3D) | 1–20 mSv | Trauma, nódulos pulmonares, abdômen |

| RM | Ressonância magnética nuclear (¹H) | 0,5–2,0 mm (3D) | Zero (não ionizante) | Tecidos moles, neuro, musculoesquelético |

| Ultrassom | Reflexão de ondas acústicas | 0,1–1,0 mm (axial) | Zero (não ionizante) | Portátil, tempo real, vascular |

| PET | Coincidência fótons 511 keV (FDG-¹⁸F) | 4–6 mm | 5–25 mSv | Metabolismo tumoral, estadiamento |

| SPECT | Cintilação (Tc-99m) | 8–12 mm | 5–20 mSv | Perfusão miocárdica, neurologia |

Padrão DICOM e gestão de imagens médicas

Toda imagem médica digital circula no padrão DICOM (Digital Imaging and Communications in Medicine), que especifica tanto o formato de arquivo, metadados estruturados em tags + pixel data, quanto o protocolo de rede para armazenamento e recuperação. Os serviços centrais são C-STORE (envio), C-FIND (consulta) e C-MOVE (recuperação). O PACS (Picture Archiving and Communication System) é a infraestrutura hospitalar que centraliza esse fluxo. Interfaces modernas incluem DICOMweb (STOW-RS, WADO-RS, QIDO-RS via HTTP/REST) e o visualizador open-source OHIF Viewer v3.11 (agosto 2025), utilizado em dezenas de projetos de pesquisa e healthtechs globais.

Na prática do processamento computacional, a biblioteca pydicom v3.0.1 (Python) lê e escreve arquivos DICOM, expondo tanto os metadados quanto o pixel array NumPy. Para volumes NIfTI (formato padrão em neuroimagem), utiliza-se nibabel ~v5.x. O SimpleITK v2.5.3 e o ITK v5.4.5 oferecem operações geométricas, registro e filtragem em 3D. Esses pacotes são as fundações sobre as quais plataformas como MONAI e nnU-Net constroem seus pipelines clínicos.

Pré-processamento: ruído, artefatos e normalização

Antes de qualquer segmentação ou classificação, o pipeline de processamento precisa lidar com degradações específicas de cada modalidade. O padrão de ruído varia fundamentalmente: TC apresenta ruído Poissoniano (proporcional à contagem de fótons); RM gera ruído Rician (combinação de ruído Gaussiano nas partes real e imaginária); ultrassom produz speckle (interferência coerente); e imagens de medicina nuclear sofrem com baixa contagem de fótons.

Os artefatos também são modalidade-específicos. Na TC: artefatos de anel (detector defeituoso), beam hardening, endurecimento de feixe por metal (MAR). Na RM: bias field (não-uniformidade de intensidade), susceptibilidade magnética, aliasing, ghosts por movimento. No ultrassom: shadowing acústico, reverberações, cone de sombra.

Windowing e realce

O windowing em TC é a técnica de mapear o intervalo de interesse de Unidades Hounsfield para a escala de cinza exibida, revelando detalhes em tecidos específicos que estariam perdidos numa escala global. Os parâmetros padrão são: janela pulmonar (W=1.500 / L=−600 HU), janela óssea (W=2.000 / L=300 HU) e janela cerebral (W=80 / L=40 HU). Para realce adaptativo, usa-se CLAHE (Contrast Limited Adaptive Histogram Equalization), que melhora contraste local sem amplificar ruído excessivamente, técnica especialmente útil em imagens de ultrassom e mamografia.

| Técnica | Aplicação principal | Parâmetros-chave | Limitação |

|---|---|---|---|

| Filtro Gaussiano | Suavização ruído Gaussiano (CT, MRI) | Sigma σ (0,5–2,0 pixels) | Borra bordas |

| Filtro Mediana | Remoção sal-e-pimenta, speckle US | Tamanho janela (3×3, 5×5) | Apaga detalhes finos |

| Filtro Bilateral | Suavização preservando bordas (MRI, TC) | Sigma espacial + sigma intensidade | Computacionalmente intensivo |

| CLAHE | Realce local de contraste (US, mamografia) | clipLimit, tileGridSize | Pode amplificar ruído se clipLimit alto |

| N4 Bias Field Correction | Correção inhomogeneidade MRI | Iterações, convergência | Pressupõe campo lentamente variável |

| Windowing HU | Visualização tecido-específica em TC | Width W, Level L | Manual; perde informação fora da janela |

Segmentação clássica e registro de imagens

A segmentação é a tarefa de atribuir rótulos a regiões da imagem, identificar onde começa o tumor, onde termina o ventrículo esquerdo, quais pixels pertencem ao fígado. Os métodos clássicos, anteriores ao aprendizado profundo, ainda são relevantes como baseline e em situações com dados limitados.

Limiarização de Otsu encontra automaticamente o threshold que maximiza a variância entre classes, funcional para estruturas com contraste nítido. Region growing parte de sementes (seeds) e cresce por conectividade e similaridade de intensidade. Watershed trata a imagem como topografia e identifica bacias de captação. Level sets (Chan-Vese) evoluem curvas ativas minimizando energia, robusto a objetos com bordas fracas. A segmentação baseada em atlas (FreeSurfer, ANTs) registra um template anatômico ao volume do paciente e propaga os rótulos, padrão-ouro em neuroimagem estrutural.

O registro de imagens alinha dois volumes que representam o mesmo paciente em momentos ou modalidades diferentes. O registro rígido tem 6 graus de liberdade (translação + rotação); o afim adiciona escala e cisalhamento (12 DOF); o deformável (B-spline, campos de deformação difeomórficos) captura variações anatômicas sutis. As métricas de similaridade mais usadas são Informação Mútua (MI, ideal para registro multimodal CT-MRI), NCC (normalized cross-correlation, monomodal) e SSD (sum of squared differences).

Redes neurais profundas: U-Net, Transformers e Mamba

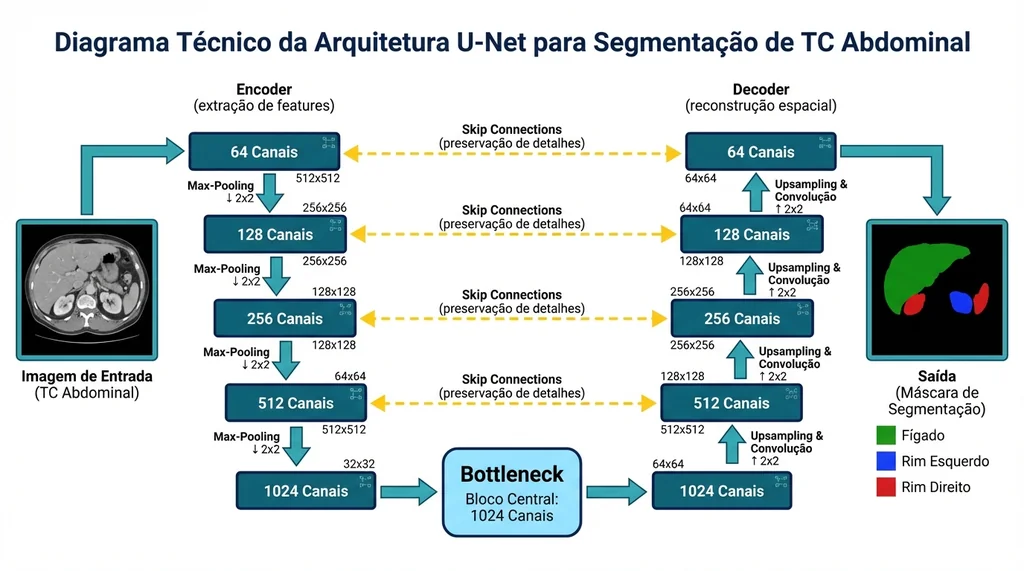

A arquitetura que definiu a segmentação médica moderna foi publicada em 2015: a U-Net (Ronneberger et al.) introduziu o encoder-decoder simétrico com skip connections, permitindo que gradientes fluíssem por caminhos curtos e que características de alta resolução fossem preservadas. O marco seguinte foi o nnU-Net (Isensee et al. Nature Methods 2021), um framework auto-configurável que ajusta automaticamente arquitetura, pré-processamento e hiperparâmetros ao dataset fornecido, e que venceu dezenas de benchmarks de segmentação. A versão nnU-Net v2 está disponível via pip.

As variantes evoluíram em diversas direções: U-Net++ com conexões densas aninhadas, Attention U-Net com portões de atenção nos skip connections, V-Net para volumes 3D nativos. A chegada dos Transformers com ViT (Vision Transformer, 2020) inaugurou a atenção global multi-cabeça na visão computacional médica. O TransUNet combinou CNN para features locais com Transformer para contexto global, obtendo +4,30% no Dice em tumores pancreáticos. O Swin-UNet e o SwinUNETR (Hatamizadeh 2022, disponível no MONAI) aplicam atenção baseada em janelas deslocadas, mais eficiente computacionalmente. Importante: benchmarks recentes mostram que CNNs bem configuradas (nnU-Net) ainda superam Transformers e modelos Mamba em muitas tarefas de segmentação 3D.

Descrição completa da imagem

Diagrama técnico da arquitetura U-Net para segmentação de imagens médicas mostrando encoder, decoder e skip connections com exemplo de segmentação abdominal (115 chars).

| Arquitetura | Ano | Inovação principal | Ponto forte | Disponível em |

|---|---|---|---|---|

| U-Net | 2015 | Encoder-decoder + skip connections | Dados escassos, segmentação geral | PyTorch, MONAI |

| nnU-Net v2 | 2021/2024 | Auto-configuração completa do pipeline | Benchmark-winning sem ajuste manual | pip install nnunetv2 |

| V-Net | 2016 | U-Net 3D volumétrico + Dice loss | Volumes TC/MRI nativos | MONAI |

| TransUNet | 2021 | CNN + ViT em encoder híbrido | +4,30% Dice pâncreas | GitHub oficial |

| SwinUNETR | 2022 | Swin Transformer + UNETR decoder | Segmentação multi-órgão CT/MRI | MONAI Bundle |

| SegResNet | 2019 | ResNet encoder + decoder residual | Tumores cerebrais (BraTS) | MONAI |

Modelos de fundação em imagens médicas

A partir de 2023, modelos treinados em escala massiva e capazes de generalizar através de modalidades e tarefas, os chamados modelos de fundação, começaram a transformar o campo. Esses modelos são pré-treinados com autossupervisão em milhões de imagens e depois adaptados (fine-tuned) a tarefas específicas com poucos dados rotulados. A diferença quantitativa é expressiva: o aprendizado autossupervisionado com DINOv2, SimCLR ou MAE reduz a necessidade de rótulos anotados em 50 a 100 vezes.

O MedSAM (Nature Communications 2024) adaptou o Segment Anything Model ao domínio médico com 1,57 milhão de pares imagem-máscara em 11 modalidades. O MedSAM2 (abril 2025) estende o SAM2 para segmentação 3D e vídeo, relevante para sequências de TC e RM cardíaca. O SAT-Pro (Nature 2025) realiza segmentação de volumes 3D com prompt textual. O BiomedParse (Microsoft, Nature Methods janeiro 2025) processa 9 modalidades com 6 milhões de triplas imagem-máscara-texto e sua versão V2 venceu o CVPR 2025. O Med-Gemini (Google 2024) atingiu 91,1% no MedQA e gerou laudos de raio-X equivalentes a radiologistas em 57–96% dos casos avaliados. O MedGemma 1.5 (2025) é o primeiro LLM multimodal aberto da Google, capaz de processar CT 3D e imagens de patologia, disponível gratuitamente no Hugging Face.

| Modelo | Publicação | Capacidade central | Acesso |

|---|---|---|---|

| MedSAM / MedSAM2 | Nature Comms 2024 / abr 2025 | Segmentação interativa 11 modalidades / 3D+vídeo | Open source (GitHub) |

| BiomedParse V2 | Nature Methods jan 2025 | 9 modalidades, 6M triplas, vencedor CVPR 2025 | Microsoft Research GitHub |

| Med-Gemini | Google 2024 | 91,1% MedQA; laudos raio-X nível radiologista | API Google |

| MedGemma 1.5 | Google 2025 | LLM multimodal aberto: CT 3D + patologia | Hugging Face (gratuito) |

| RETFound | Nature 2023 | 1,6M retinianas, SSL/MAE, AUC 0,796 para IC | Open source |

| Pillar-0 | UC Berkeley/UCSF dez 2025 | Volumes 3D CT/MRI, AUC 0,87 em 350+ achados | Pesquisa |

| CheXzero | Nature BME 2022 | Zero-shot raio-X tórax, AUC 0,889 | Open source |

Um ponto de sobriedade: meta-análise de 2025 mostra que o GPT-4 atinge 72% de acurácia diagnóstica, mas com taxa de identificação incorreta de achados de 81–94%. Radiologistas identificam 42% de achados corretos versus 3,8–7,5% para sistemas de IA isolados. A narrativa é de IA complementar, não substitutiva, e a literatura mais recente reforça essa posição consistentemente.

Aplicações clínicas consolidadas

A distância entre pesquisa e clínica encolheu rapidamente. Em radiologia torácica, o Lunit INSIGHT CXR obteve AUC 0,93 em detecção de achados pulmonares, superando radiologistas humanos (AUC 0,81 no mesmo estudo). O CheXNet (Stanford) atingiu AUC 84,11% em 14 patologias. Em mamografia o estudo MASAI (Lancet Digital Health 2024, 80.033 mulheres) demonstrou que a triagem com IA elevou a detecção de câncer de 5,1 para 6,1 por 1.000 mulheres (+20%) e reduziu a carga de leitura em 44,3%; o AI-STREAM (Nature Communications 2025) mostrou +13,8% adicional.

No estudo MASAI (80.033 mulheres), a triagem mamográfica assistida por IA elevou a taxa de detecção de câncer de 5,1 para 6,1 por 1.000 mulheres (+20%) e reduziu a carga de leitura dos radiologistas em 44,3%.

— Lancet Digital Health, 2024

Em neuroimagem o SynthSeg (Medical Image Analysis 2023, integrado ao FreeSurfer 7.3.2+) segmenta estruturas cerebrais mesmo em imagens de baixa qualidade, treinado com dados sintéticos de 15.000+ scans. O FastSurfer realiza segmentação completa em ~1 minuto em GPU versus 6–8 horas do FreeSurfer clássico. O Viz.ai (primeiro clearance FDA em 2018, hoje em 1.700+ hospitais) reduz em 52 minutos o tempo de notificação de AVC. Em patologia digital o Paige Prostate foi o primeiro software de patologia aprovado pelo FDA (2021); modelos como Virchow (632M parâmetros, 1,5M WSIs) e UNI (100M+ patches) definem o estado da arte.

| Especialidade | Aplicação/Produto | Métrica de desempenho | Status regulatório |

|---|---|---|---|

| Radiologia torácica | Lunit INSIGHT CXR | AUC 0,93 (vs. radiologista 0,81) | FDA clearance, ANVISA (em andamento) |

| Mamografia | Triagem IA (estudo MASAI) | +20% detecção, −44,3% carga leitura | CE Mark; FDA De Novo vários produtos |

| Nódulo pulmonar | Veye Chest / ClearRead CT | Sensibilidade >95% (LUNA16) | FDA 510(k) clearance |

| Neuroimagem / AVC | Viz.ai | −52 min notificação AVC | FDA 2018; 1.700+ hospitais |

| Retina | IDx-DR / EyeArt | Sens 87,2% / 96%, Esp 90,7% | FDA De Novo (screening autônomo) |

| Patologia digital | Paige Prostate / Virchow | AUC 0,95 (Virchow); aprovado FDA | FDA (2021) / Pesquisa |

| Ortopedia | BoneView | AUC 0,97; −29% falsos negativos | FDA clearance |

| Cardiologia (Eco) | Caption AI (GE) | Primeiro FDA para aquisição guiada IA | FDA clearance |

Ferramentas e ecossistema Python

Python é a língua franca do processamento de imagens médicas em pesquisa e desenvolvimento. Para uma comparação detalhada entre Python e MATLAB e quando usar cada ferramenta, consulte nosso artigo sobre Python e MATLAB na engenharia biomédica. O ecossistema amadureceu a ponto de cobrir todo o pipeline, da leitura de DICOM ao deploy em produção clínica, com ferramentas estáveis e mantidas ativamente.

O MONAI v1.5.2 (NVIDIA + King's College London) é hoje a plataforma mais completa para IA em imagens médicas. Oferece transforms otimizadas para volumes 3D, implementações de U-Net, SegResNet, SwinUNETR e ViT, SmartCache para datasets grandes, loss functions especializadas (DiceLoss, FocalLoss, DiceCELoss) e suporte a exportação TensorRT/ONNX. O MONAI Label v0.8.4+ permite anotação ativa com modelos de aprendizado contínuo; o MONAI Bundle fornece 15+ modelos pré-treinados prontos para uso. Em outubro de 2025, o MONAI adicionou suporte a AMD ROCm. O TotalSegmentator v2.12.0 (dezembro 2025) segmenta 117+ estruturas anatômicas em TC e MRI.

Para processamento clássico, o OpenCV ~v4.10 (~79K estrelas no GitHub) fornece operações de imagem 2D de alta performance. O scikit-image v0.26.0 oferece implementações limpas de filtros, morfologia e segmentação. O SimpleITK v2.5.3 facilita operações geométricas e registro de imagens com interface Python simples. O TorchIO é a referência para augmentação de dados 3D com transformações anatomicamente plausíveis.

| Biblioteca | Versão (2025/2026) | Função principal | Uso típico |

|---|---|---|---|

| pydicom | v3.0.1 | Leitura/escrita DICOM | Parsing metadados + pixel array |

| nibabel | ~v5.x | NIfTI, MINC, Analyze | Neuroimagem (FreeSurfer output) |

| SimpleITK | v2.5.3 | Registro, reamostragem, filtros 3D | Pré-processamento pipeline clínico |

| MONAI | v1.5.2 | IA médica end-to-end (treino → deploy) | Segmentação, classificação, detecção |

| nnU-Net v2 | pip install nnunetv2 | Segmentação auto-configurável | Benchmarks, competições, pesquisa |

| TotalSegmentator | v2.12.0 (dez 2025) | Segmentação 117+ estruturas CT/MRI | Radiômica, planejamento cirúrgico |

| OpenCV | ~v4.10 | Visão computacional 2D | Endoscopia, patologia digital 2D |

| TorchIO | Ativa | Augmentação 3D anatomicamente plausível | Treinamento com dados limitados |

Datasets públicos são fundamentais para pesquisa reproduzível. O TCIA (The Cancer Imaging Archive) agrega 100+ coleções. Os mais utilizados incluem: BraTS (~2.000+ casos, tumores cerebrais), CheXpert (224.316 raio-X, Stanford), MIMIC-CXR (377.110 imagens, MIT), ChestX-ray14 (112.120 imagens, NIH), LUNA16 (888 CTs para nódulos) e ISIC (70.000+ dermoscopia). Para tarefas múltiplas, o Medical Segmentation Decathlon padroniza 10 tarefas em 10 órgãos/patologias. A plataforma Grand Challenge hospeda competições contínuas com leaderboards públicos.

Cenário brasileiro: pesquisa, empresas e desafios

O Brasil ocupa posição relevante no processamento de imagens médicas globalmente, com contribuições científicas consolidadas e um ecossistema de healthtechs em aceleração. O país conta com mais de 50 centros de pesquisa em engenharia biomédica, vários com foco específico em imagens.

O LAPIMO/USP São Carlos (Prof. Homero Schiabel) desenvolve sistemas de CAD para mamografia há mais de 20 anos, um dos grupos mais antigos da América Latina na área. O LEB/POLI-USP ativo desde 1981 com parceria com o InCor, desenvolveu sistemas de análise cardíaca por imagem há décadas. O PEB-COPPE/UFRJ (conceito CAPES 6, laboratório LAPIS) formou 548 mestres e 178 doutores, com pesquisa em reconstrução tomográfica e análise de imagens nucleares. A UFPE recebeu R$14,7 milhões do FINEP para o projeto Saúde Inteligente, com componente forte em imagens médicas. O NIMed/PUC-RS e o IEB/UFSC em telemedicina completam o mapa.

Pesquisadores como Felipe Kitamura (DASA/DasaInova) e Edson Amaro Junior (Hospital Einstein) criaram o dataset BRAX (Nature Scientific Data 2022, em parceria com o MIT): 40.967 radiografias de tórax de 19.351 pacientes, disponível no PhysioNet com rótulos gerados pelo CheXpert adaptado ao português, a maior coleção pública de raio-X do Brasil e referência para avaliar modelos em populações latino-americanas.

No lado das empresas, a Pixeon (Florianópolis) é a maior healthtech de imagens do Brasil: seu PACS Aurora foi eleito Best in KLAS para América Latina, com 3.000+ clientes e 150 milhões de exames processados. O módulo Lumine CAD Pulmonar analisa nódulos automaticamente. A NeuralMed desenvolveu a plataforma TrIA de triagem por IA, presente em redes como Fleury e Hapvida, cobrindo 5 milhões de vidas com R$13,2 milhões captados. A Audo registrou o DAMA na ANVISA, primeiro sistema de IA para mamografia com registro brasileiro. A Ninsaúde oferece 17 modelos de análise de raio-X com laudos em 60 segundos (224Scan AI). A Linda (Toronto/Brasil) aplica IA em imagem de mama com R$10 milhões captados em seed, atendendo 4 milhões de mulheres.

O Hospital de Amor (Barretos) é caso exemplar de impacto: 100% SUS, 4.100 atendimentos por dia, implementou IA para análise de mamografia com 50+ unidades móveis percorrendo municípios onde 80% não têm acesso regular ao exame. No Hospital Einstein, aproximadamente 120 algoritmos de IA estão em uso clínico, incluindo Lunit INSIGHT para triagem de emergência e sistemas para detecção de TB, Zika e AVC.

| Empresa/Instituição | Produto/Contribuição | Escala | Diferencial |

|---|---|---|---|

| Pixeon (Florianópolis) | PACS Aurora + Lumine CAD | 3.000+ clientes, 150M exames | Best in KLAS LatAm; CAD nódulo pulmonar |

| NeuralMed | TrIA (triagem IA) | 5M vidas, Fleury/Hapvida | R$13,2M captados; foco em triage rápida |

| Audo | DAMA (mamografia IA) | Registro ANVISA | Primeiro SaMD de mamografia aprovado BR |

| Hospital de Amor (Barretos) | IA mamografia + unidades móveis | 50+ unidades, 4.100/dia | 100% SUS; alcance em municípios remotos |

| LAPIMO/USP São Carlos | CAD mamografia (20+ anos) | Acadêmico | Referência nacional em CAD mamário |

| BRAX (Einstein + MIT) | Dataset 40.967 raio-X tórax | PhysioNet público | Maior dataset público de RX do Brasil |

Apenas 4% dos estabelecimentos de saúde brasileiros realizaram análises de Big Data em 2023, e 80% dos municípios não possuem cobertura mamográfica regular.

— TIC Saúde / IBGE, 2023

Os desafios estruturais são significativos: apenas 4% dos estabelecimentos de saúde realizaram atividades de Big Data em 2023 (IBGE); 80% dos municípios não têm acesso regular à mamografia; a fila para TC e RM em cidades como Florianópolis estende-se até 2034. Esses números definem, paradoxalmente, a maior oportunidade: sistemas de IA acessíveis, edge AI em dispositivos portáteis e telemedicina têm potencial transformador precisamente onde a infraestrutura tradicional falha.

Regulamentação: FDA, ANVISA e a era do SaMD

A trajetória regulatória do FDA ilustra a explosão da IA médica: de 33 dispositivos autorizados no período 1995–2015 para 1.356 em setembro de 2025 com recorde de 295 apenas em 2025, e 77% concentrados em radiologia. O FDA opera com frameworks distintos para software: 510(k) (equivalência substancial), De Novo (nova classe de risco), PMA (aprovação pré-mercado para alto risco) e o emergente PCCP (Predetermined Change Control Plan) para modelos que precisam ser atualizados continuamente com novos dados.

No Brasil, a ANVISA publica a RDC 751/2022 (regras gerais de dispositivos médicos) e a RDC 657/2022 específica para Software as a Medical Device (SaMD). A classificação de risco vai de Classe I (baixo risco, notificação simples) a Classe IV (alto risco, registro completo). Softwares adaptativos e algoritmos de IA estão em revisão, a ANVISA avalia incorporar o PCCP e frameworks de IA explicável. O PL 2.338/2023 classifica sistemas de IA em saúde diagnóstica como alto risco, exigindo avaliação de conformidade prévia. Mais detalhes em regulamentação ANVISA de dispositivos médicos.

Internacionalmente, o EU AI Act (vigência plena em 2026) classifica IA para diagnóstico médico como alto risco, com obrigações de transparência, auditabilidade e supervisão humana. A ISO/IEC 42001 (sistema de gestão de IA) e a ISO 14971 (gestão de riscos) formam a base normativa para desenvolvedores. Uma análise comparativa completa está disponível em normas técnicas em engenharia biomédica.

Hardware, cloud e requisitos computacionais

O processamento de imagens médicas 3D com deep learning é computacionalmente intensivo. A hierarquia atual de GPUs para treinamento inclui a NVIDIA A100 80 GB e H100 80 GB (data centers), a RTX 5090 32 GB (workstation, ~R$14.000–18.000) e a B200 192 GB para modelos de fundação. Os requisitos práticos variam: segmentação 2D (8–16 GB VRAM), segmentação 3D com U-Net (24–48 GB), fine-tuning de modelos de fundação (24–80 GB), treinamento de modelos de fundação completo (centenas de GB em paralelo).

Para equipes sem GPUs dedicadas, as plataformas de cloud específicas para saúde incluem: Google Healthcare API (DICOM stores, ML); AWS HealthImaging (armazenamento e acesso médico); Azure Health Data Services; e NVIDIA Clara (pipeline completo de IA médica, com Parabricks para genômica). O aprendizado federado com NVIDIA FLARE v2.7 permite treinar modelos em dados distribuídos por hospitais sem mover dados sensíveis, relevante para compliance com LGPD.

No ponto de uso clínico (edge AI), destaque para o Butterfly iQ3 (FDA, Compass AI, novembro 2025) com ultrassom guiado por IA, e o Hyperfine MRI portátil (NVIDIA Clara AGX, FDA para difusão, dezembro 2025), tecnologias que levam capacidade diagnóstica a unidades básicas e áreas remotas do Brasil.

Desafios críticos: anotação, viés e explicabilidade

Os obstáculos que separam protótipos de pesquisa de ferramentas clínicas confiáveis são bem caracterizados. O custo de anotação de dados médicos é o mais imediato: especialistas cobram R$100–500 por hora (equivalente a US$100–500 em contextos de pesquisa global), e volumes 3D de alta qualidade exigem dezenas a centenas de horas por estrutura. O class imbalance é regra, não exceção, patologias raras representam 0,1–5% dos pixels, e loss functions como focal loss e Dice loss foram desenvolvidas especificamente para esse problema.

O viés algorítmico é um risco documentado: estudo publicado na Science Advances em 2025 identificou subdiagnóstico sistemático em grupos marginalizados por modelos treinados em datasets não representativos. O EU AI Act e o PL 2.338/2023 brasileiro exigem análise de fairness como requisito regulatório. A explicabilidade (XAI) é demanda clínica e regulatória: Grad-CAM, SHAP e modelos como ProtoENet (MICCAI 2025) geram mapas de atenção que justificam predições, mas a maioria dos médicos ainda não sabe interpretá-los, gap que o ensino médico-tecnológico precisa endereçar.

As métricas de avaliação padrão para segmentação incluem o Dice Similarity Coefficient (DSC = 2|A∩B|/(|A|+|B|)), IoU/Jaccard, Hausdorff Distance 95th percentile (HD95, sensível a outliers de borda), AUC-ROC, F1 e FROC (Free-Response ROC, para detecção). A Hausdorff Distance 95 é particularmente importante em radioterapia, onde erros de contorno têm impacto direto na dose entregue ao tecido saudável.

Tendências: digital twins, edge AI e aprendizado federado

O mercado de gêmeos digitais em medicina foi estimado em US$ 2,09 bilhões em 2024, com projeção de US$ 15,2 bilhões até 2032, representando um CAGR de 28,17%.

— Grand View Research, 2024

O mercado de gêmeos digitais em saúde foi estimado em US$ 2,09 bilhões em 2024 e projeta-se para US$ 15,2 bilhões em 2032 (CAGR 28,17%). O FEops HEARTguide obteve clearance FDA para planejamento de TAVI; a Siemens e a Mayo Clinic anunciaram projeto conjunto em setembro de 2025 para gêmeos digitais cardíacos. O FDA publicou draft guidance sobre digital twins em janeiro de 2025, sinal de maturação regulatória.

O aprendizado federado resolve o dilema fundamental: como treinar modelos em dados de múltiplos hospitais sem violar a LGPD e normas de privacidade? Cada instituição treina localmente e compartilha apenas gradientes ou pesos do modelo, não os dados dos pacientes. O NVIDIA FLARE v2.7 é a plataforma de referência para implementações hospitalares. O SSL (Self-Supervised Learning) com DINOv2 para patologia, MAE para retina (RETFound) e SimCLR em MRI 3D (18.759 pacientes, ICCV 2025) está redefinindo o que é possível com poucos rótulos.

A convergência entre processamento de imagens e outras modalidades de dados biológicos, a radiogenômica e a multi-ômica, é uma fronteira em expansão. Empresas como Tempus lideram a integração de dados de imagem, genômica e prontuário eletrônico para prognóstico personalizado. Para um panorama completo das tendências que estão remodelando a engenharia biomédica, acesse o artigo sobre tendências e futuro da engenharia biomédica.

Carreira em processamento de imagens médicas

O profissional especializado em processamento de imagens médicas opera na interseção entre engenharia biomédica, ciência de dados e medicina, uma das combinações com maior valorização salarial do setor de saúde digital. No Brasil, salários para engenheiros biomédicos (CBO 2143-80) variam de R$7.659 (júnior) a R$13.262 (sênior), com teto de R$14.782. Especialistas em IA/Data Science sênior no setor saúde atingem R$20.000–45.000/mês especialmente em grandes healthtechs e hospitais como DASA e Einstein.

No mercado internacional, a posição de Medical Imaging Engineer tem mediana de US$ 150.176/ano (Glassdoor, faixa US$ 117K–195K), com posições sênior na NVIDIA, Google e Microsoft alcançando US$ 200K–450K+. Na Alemanha, engenheiros biomédicos recebem €47.500–70.000, e especialistas em IA em saúde €50.000–85.000. As empresas que mais contratam são Siemens (AI Pathway Companion), GE Healthcare (Edison AI, US$ 249 milhões investidos em IA em fevereiro 2025), Philips (parceria NVIDIA MR Foundation Model, maio 2025) e Canon/Fujifilm. No ecossistema de healthtechs de IA, Aidoc, Viz.ai (50+ algoritmos), Lunit, Qure.ai e HeartFlow são os empregadores mais ativos.

Para mais informações sobre remuneração e oportunidades, veja salários em engenharia biomédica e o panorama completo do mercado de trabalho. O processamento de sinais biomédicos com Python é área complementar fundamental para quem trabalha com dados de saúde. Entender o contexto de empresas do setor está detalhado em empresas de engenharia biomédica no Brasil. Para quem busca formação, os centros de pesquisa em engenharia biomédica incluem os principais grupos de imagens médicas do país.

| Perfil | Brasil (mensal) | EUA (anual) | Alemanha (anual) | Habilidades-chave |

|---|---|---|---|---|

| Eng. Biomédico Júnior | R$7.659 | US$80K–100K | €40K–50K | Python, DICOM, MONAI básico |

| Eng. Biomédico Sênior | R$13.262–14.782 | US$130K–160K | €55K–70K | PyTorch, nnU-Net, regulatório |

| IA/Data Science Saúde | R$20.000–45.000 | US$160K–220K | €60K–85K | Modelos fundação, MLOps, XAI |

| Medical Imaging Engineer | R$25.000+ (DASA/Einstein) | US$150K–195K | €65K–80K | Pipeline clínico, FDA/ANVISA |

A formação de referência combina graduação em engenharia biomédica, elétrica, computação ou física com pós-graduação especializada. Os programas nacionais mais sólidos são o PEB-COPPE/UFRJ (conceito CAPES 6), o MICLab/CEB-UNICAMP, o LEB/POLI-USP e o PPGEB/UFPE. Para quem considera pós-graduação, veja mestrado e doutorado em engenharia biomédica. Ideias de TCC para explorar o campo estão em ideias de TCC em engenharia biomédica. O congresso de referência é o MICCAI, em 2025, foram aceitos 1.027 trabalhos de 3.447 submetidos (taxa de aceitação de 29,8%), refletindo a competitividade do campo.

Perguntas frequentes sobre processamento de imagens médicas

O que é processamento de imagens médicas e como ele difere da visão computacional geral?

Processamento de imagens médicas aplica técnicas de visão computacional a imagens geradas por modalidades como TC, RM, raio-X, ultrassom e medicina nuclear, com o objetivo de diagnóstico, triagem ou auxílio ao planejamento terapêutico. A diferença central está no contexto: imagens médicas são volumétricas (3D e 4D), anisotrópicas (resolução diferente em cada eixo), seguem o padrão DICOM com metadados clínicos ricos, e os erros têm consequências diretas para pacientes. A anotação exige especialistas médicos, os datasets são menores e mais caros que em visão computacional geral, e a regulamentação (FDA, ANVISA) impõe requisitos de validação clínica que não existem em aplicações de consumo.

Qual a diferença entre segmentação semântica e segmentação de instâncias em imagens médicas?

Na segmentação semântica, cada pixel é classificado em uma categoria (fígado, tumor, rim) sem distinguir múltiplas instâncias da mesma classe, adequada para órgãos únicos. Na segmentação de instâncias, cada objeto individual recebe um rótulo próprio, essencial para contar metástases, lesões ou células individualmente. Em patologia digital e análise de nódulos pulmonares (onde múltiplos nódulos podem coexistir), a segmentação de instâncias é obrigatória. O framework Mask R-CNN e variantes são referência para instâncias em 2D; o nnU-Net com pós-processamento por connected components trata casos 3D.

Por que o Dice coefficient é a métrica padrão em segmentação médica e quando não usá-lo?

O Dice Similarity Coefficient (DSC) é robusto ao desbalanceamento de classes, característica crítica quando uma lesão ocupa 0,1% da imagem, porque normaliza pelo tamanho dos conjuntos, não pela resolução total. Porém, o Dice não penaliza erros de localização geométrica: uma segmentação com bom Dice pode ter bordas erradas clinicamente relevantes, por isso a Hausdorff Distance 95th percentile (HD95) é usada complementarmente. Em detecção de nódulos, o FROC (Free-Response ROC) é preferido porque considera sensibilidade por lesão versus falsos positivos por imagem. Em classificação binária (imagem normal/anormal), AUC-ROC e F1 são mais informativos que Dice.

O que é o nnU-Net e por que ele ainda vence benchmarks mesmo com arquiteturas mais novas?

O nnU-Net é um framework de segmentação auto-configurável: dado um novo dataset, ele analisa automaticamente as propriedades das imagens (espaçamento, intensidades, tamanho médio das estruturas) e configura arquitetura, pré-processamento, tamanho de patch, data augmentation e hiperparâmetros de treinamento sem intervenção manual. A validação cruzada 5-fold é padrão, garantindo robustez estatística. Ele vence benchmarks porque a maior parte do ganho em segmentação médica vem de engineering choices corretos (normalização, resampling) e não da arquitetura em si, insight contraintuitivo mas bem documentado na literatura. Transformers e Mamba podem superar o nnU-Net em datasets específicos, mas raramente em avaliações amplas multi-tarefa.

Como a LGPD afeta projetos de processamento de imagens médicas no Brasil?

A LGPD classifica imagens médicas como dados sensíveis de saúde, sujeitos ao nível mais elevado de proteção. Para projetos de pesquisa, é necessário consentimento explícito ou aprovação de Comitê de Ética (CEP/CONEP) com base em interesse legítimo de pesquisa. Dados anonimizados (face removida, metadados DICOM limpos) ficam fora do escopo da LGPD se a identificação for tecnicamente impossível. Sanções chegam a 2% do faturamento bruto, limitado a R$50 milhões por infração. O uso de aprendizado federado (NVIDIA FLARE) é a abordagem técnica recomendada para treinar modelos em dados de múltiplos hospitais sem transferência de dados brutos.

Quais datasets públicos de imagens médicas em português ou com população brasileira estão disponíveis?

O principal é o BRAX (Brazilian Labeled Chest X-ray Dataset, Nature Scientific Data 2022): 40.967 radiografias de tórax de 19.351 pacientes do Hospital Einstein, com rótulos em português gerados pelo CheXpert adaptado, disponível no PhysioNet. O PROADI-SUS do Einstein também criou banco de imagens para TB, Zika e AVC. O Hospital de Amor em Barretos possui um dos maiores acervos de imagens oncológicas do Brasil, com crescente abertura para pesquisa. Para neuroimagem, a COPPE/UFRJ e o CEB/UNICAMP têm colaborações internacionais com acervos de imagens cerebrais brasileiras.

Qual é o caminho regulatório para registrar um software de IA de imagens médicas na ANVISA?

A RDC 657/2022 define o enquadramento como SaMD. Softwares de diagnóstico por imagem com IA são tipicamente Classe III ou IV, exigindo registro completo (não apenas notificação). O processo inclui: dossier técnico com evidências de desempenho clínico, análise de risco (ISO 14971), documentação de ciclo de vida de software (IEC 62304), validação clínica em população brasileira ou com dados representativos, e sistema de gestão da qualidade (ISO 13485). O tempo médio para registro Classe III é 18–36 meses. Softwares desenvolvidos por hospitais para uso interno próprio (sem comercialização) são isentos de registro. Veja o artigo completo sobre regulamentação ANVISA de dispositivos médicos.

Vale a pena usar um modelo de fundação pré-treinado ou treinar um modelo do zero para minha aplicação?

Quase sempre vale começar com um modelo pré-treinado. O transfer learning com pesos de ImageNet ou RadImageNet acelera convergência e melhora desempenho mesmo quando o domínio difere. Para tarefas de segmentação 3D, o MONAI Bundle oferece 15+ modelos pré-treinados que podem ser fine-tuned com poucas centenas de casos. Modelos de fundação como MedSAM2 e BiomedParse são especialmente úteis quando se tem menos de 100 casos anotados, reduzindo a necessidade de rótulos em 50–100 vezes com SSL. Treinar do zero é justificado apenas para modalidades muito específicas sem dados públicos similares, ou quando há volume massivo de dados proprietários (>100.000 casos) que justifica o custo computacional.

Para aprofundar sua formação, explore o artigo sobre instrumentação biomédica a base de hardware que gera as imagens processadas, e o guia de sensores vestíveis em saúde onde processamento de imagem de baixo custo encontra aplicações de monitoramento contínuo. O ecossistema completo de empresas inovadoras está em healthtechs do Brasil. Para continuar sua jornada de aprendizado, acesse o Guia Definitivo de Engenharia Biomédica com todos os tópicos da área organizados do básico ao avançado. Conteúdo produzido e revisado pela equipe de engenhariabiomedica.com.

Artigos relacionados

Biomateriais: Dos Implantes de Titânio à Bioimpressão 3D [2026]

Guia técnico-científico completo sobre biomateriais na engenharia biomédica: classificação, biocompatibilidade, aplicações clínicas, empresas brasileiras, bioimpressão 3D e mercado global de USD 48 bilhões.

Biomecânica na Engenharia Biomédica [2026]: FEA, Próteses e Análise de Movimento

Guia técnico completo sobre biomecânica na engenharia biomédica: propriedades mecânicas de tecidos, análise de movimento por captura óptica e IA, pipeline de elementos finitos (FEA), design de próteses, implantes ortopédicos, biomecânica cardiovascular e as principais tendências de 2026.

Centros de Pesquisa em Engenharia Biomedica: Mapa Completo do Brasil [2026]

Guia atualizado com mais de 50 centros de pesquisa em engenharia biomedica em 13 estados brasileiros. Conheca os programas com nota CAPES 6 e 7, laboratorios de referencia, linhas de pesquisa, financiamento e como ingressar na pos-graduacao.

Como Publicar Artigos Cientificos em Engenharia Biomedica: Guia Completo [2026]

Guia pratico para publicar artigos cientificos em Engenharia Biomedica: escolha de revistas (Nature BME, IEEE, RBEB), metricas de impacto (JIF, CiteScore, h-index), acesso aberto via CAPES, custos de APC e estrategias para aumentar suas chances de aceite em 2026.